LLM (Büyük Dil Modelleri), bildiğiniz üzere günlük hayatımızda önemli bir rol oynamaktadır. Çoğumuz LLM uygulamalarını (ChatGPT, Gemini, DeepSeek vs.) kullanarak sorular sormakta; pratik şekilde derli toplu ve hızlı cevaplar almaktayız. LLM’ler esasında metni adım adım oluşturan bir tahmin makinesidir. Her adımda, o ana kadarki tüm kelimelere bakıp sıradaki kelimenin ne olması gerektiğini tahmin eder. Eğitilirken de aynı şekilde çok fazla metin üzerinde “sıradaki kelime ne olmalı?” sorusunun doğru yanıtını öğrenir. Kullandığımızda da bu tahminleri ardı ardına yaparak uzun cümleler üretir.

Son zamanlarda LLM’leri kullanarak uygulama geliştirme süreçlerini hızlandırmak ve farklı işleri daha pratik hale getirmek mümkün olmuştur. Örneğin, bir dokümanı LLM’e girdi olarak vererek dokümanla ilgili sorular sorabiliriz. Benzer şekilde, bir API’ye bağlanıp veri çekerek bu veriler hakkında sorular sorabilir ve hızlı bir şekilde yanıtlar elde edebiliriz.

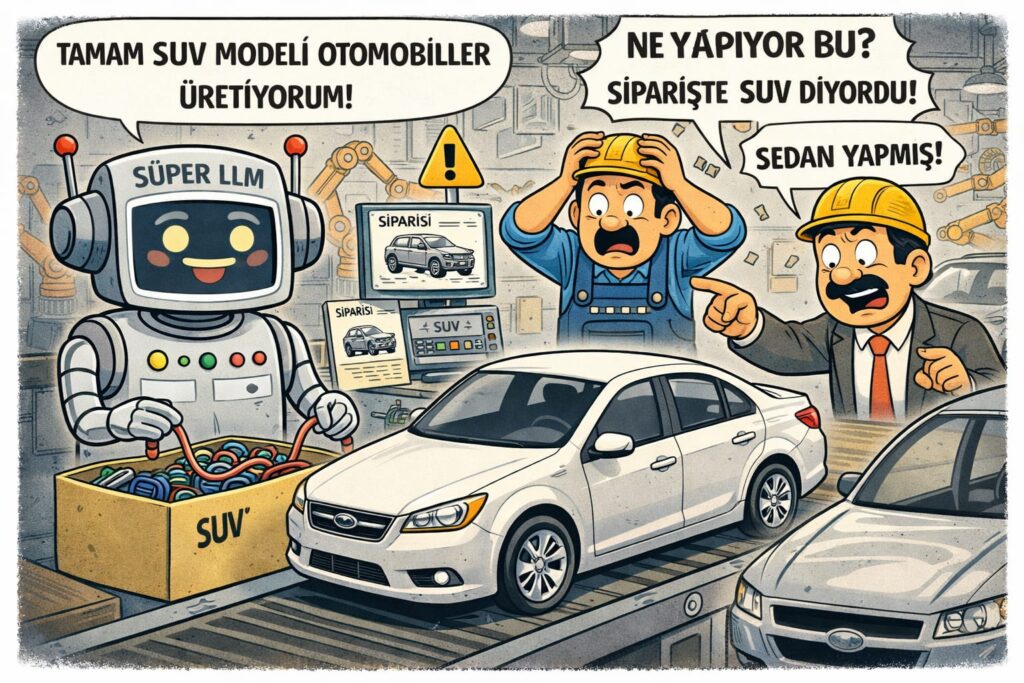

Ancak LLM’leri kullanarak uygulama geliştirmek her zaman doğru sonuçlar üretir mi? Özellikle %100 doğruluk beklenen uygulamalarda, bir sisteme yöneltilen sorulara her zaman doğru ve beklenen yanıtın verilmesi büyük önem taşır. Aksi takdirde yanlış kararlar; hatalı üretime veya yanlış teşhise neden olabilir.

İşte bu noktada, karşımıza LLM’lerin en büyük handikapı olan Halüsinasyon problemi çıkmaktadır. LLM’lerin Halüsinasyon görmesi, modelin özgüvenli bir şekilde yanlış bir cevabı doğruymuş gibi vermesidir.

Halüsinasyon, dil modelleri tarafından üretilen inandırıcı fakat yanlış ifadelerdir. 2025 Eylül ayında OpenAI tarafından yayınlanan bir araştırma makalesinde, dil modellerinin halüsinasyon problemine ve bu konunun düzeltilmesi için halen çalışmalar yapıldığı belirtilmektedir. Büyük Dil Modelleri, gerçeği bilmek veya doğrulamak için değil, verilen soruya karşılık en olası metni üretmek üzere eğitilir. Model, bir sorunun cevabını gerçekten bilmese bile boş bırakmak yerine tahminde bulunmayı öğrenir. Bunun nedeni, eğitim sürecinde akıcı ve tutarlı bir cevap üretmenin (yanlış olsa bile) hiç cevap vermemeye kıyasla daha fazla ödüllendirilmesidir. Bu yaklaşım, LLM’lerin halüsinasyon olarak adlandırılan yanlış ama kulağa oldukça ikna edici gelen cevaplar üretmesine yol açar.

Model performansı değerlendirilirken dürüstçe “bilmiyorum” demek değil, tahmin ederek bir cevap sunmak teşvik edilir. Bu durumu çoktan seçmeli bir sınavla benzetebiliriz: Model, cevabı bilmediğinde boş bırakırsa sıfır alacağını “öğrenmiştir”, bu yüzden bir şıkkı işaretlemeyi tercih eder. LLM’ler de benzer bir ödül mekanizmasıyla çalıştığı için, bilmediği sorularda cevap vermemek yerine yorum yapar. Ancak bu tür tahmine dayalı cevaplar, özellikle hassas veya kritik uygulamalarda kullanıldığında ciddi ve kontrol edilmesi zor sorunlara yol açabilir. Bu nedenle LLM tabanlı sistemler geliştirirken, modelin her zaman doğruyu söylemediğini ve bazen sadece tahmin ettiğini unutmamak büyük önem taşır.

Halüsinasyon handikapını aşmanın en basit ve etkili yolu, Prompt Mühendisliğidir. Peki, Promp Mühendisliği nedir? Nasıl kullanılmalıdır?

Prompt, bir LLM’e verdiğimiz girdi; yani soru, talimat veya bağlamdır. Kısacası modele ne yapmasını istediğimizi anlatan metindir. Prompt mühendisliği ise, LLM’lerden doğru, tutarlı ve amaca uygun çıktılar alabilmek için bu girdileri bilinçli ve stratejik şekilde tasarlama sanatıdır. Modelin nasıl düşüneceğini ve hangi çerçevede cevap vereceğini prompt belirler.

Prompt mühendisliğinin temel amaçları şunlardır:

- Modelin doğru ve anlaşılır cevaplar üretmesini sağlamak

- Belirsiz, yanlış veya eksik yanıtların önüne geçmek

- İstenen formatta ve yapıda çıktı elde etmek

İyi bir prompt mühendisliği, modelin tahmin etmeye meyilli doğasını kontrol altına alır ve onu doğru yöne kanalize eder. Yukarıda bahsettiğimiz halüsinasyon problemini azaltmanın yolu da buradan geçer. Modelin potansiyelini en verimli şekilde kullanmak, ancak ne istediğimizi net, açık ve bağlamı güçlü promptlarla ifade etmekle mümkündür. Doğru tasarlanmış bir prompt, LLM’in yeteneklerini ortaya çıkarırken, yanlış veya eksik tasarlanmış bir prompt aynı modelden oldukça zayıf sonuçlar alınmasına neden olabilir.

Prompt mühendisliğinin etkisini iyi ve kötü prompt örnekleri karşılaştırarak görebiliriz.

Kötü Prompt Örneği:

Yapay zekâ hakkında bilgi ver.Bu prompt:

- Çok genel bir ifade

- Bağlam içermiyor (ek bilgi)

- Çıktının formatı belirsiz

Model, böyle bir prompt karşısında tahmine dayalı, yüzeysel veya gereksiz detaylar içeren bir cevap üretme eğiliminde olur.

İyi Prompt Örneği

Yapay zekâyı, teknik altyapısı olmayan bir okuyucuya yönelik olarak, 3 paragraf halinde ve basit bir dille açıkla. Akademik terimlerden kaçın.Bu prompt:

- Hedef kitleyi tanımlar

- Formatı netleştirir

- Modelin cevap alanını sınırlar

Sonuç olarak daha kontrollü, amaca uygun ve güvenilir bir çıktı elde edilir.

Halüsinasyonu Azaltan Prompt Teknikleri

Büyük Dil Modellerinin tahmin etmeye dayalı çalışma prensibi nedeniyle halüsinasyonu tamamen ortadan kaldırmak mümkün değildir. Ancak doğru prompt teknikleriyle bu risk ciddi ölçüde azaltılabilir. Aşağıda, pratikte en etkili ve yaygın olarak kullanılan yöntemleri bulabilirsiniz:

1. Chain-of-Thought Prompting (Düşünce Zinciri)

Chain-of-Thought Prompting, yapay zekâ modeline bir problemi çözerken ara adımları açıkça ifade etmesini söyleyen bir yönlendirme tekniğidir. Yani model sadece cevabı vermez; aynı zamanda çözüm sürecini de paylaşır.

Güçlü yönleri:

- Modelin adım adım mantık yürütmesini sağlar.

- Tutarsızlıkları ve mantıksal atlamaları azaltır.

- Özellikle hesaplama, mantık ve analiz gerektiren görevlerde etkilidir.

Zayıf yönleri:

- Model yanlış veya eksik bir bilgiyle başlarsa, hatayı adım adım sürdürür.

- Kaynak doğrulaması yoksa, “mantıklı ama yanlış” sonuçlar üretebilir.

Öneriler:

Prompt’a şu tür ifadeler ekleyin:

Adım adım düşün ve her adımı mantıklı biçimde açıkla.

Sonuca geçmeden önce ara adımları kontrol et.2. Few-shot Prompting (Örnekli Yönlendirme)

Few-shot prompting, modele bir görev vermeden önce birkaç örnek giriş-çıkış çifti sunarak, beklenen davranışı öğretme yöntemidir.

Güçlü yönleri:

- Model, verilen örneklerin formatını ve bilgi tarzını taklit eder.

- Doğru örnekler kullanıldığında yanlış üretim ihtimali azalır.

Zayıf yönleri:

- Örneklerdeki hatalar doğrudan modele taşınır.

- Yanlış veya eksik örnekler halüsinasyonu tetikler.

Öneriler:

- Yalnızca doğru ve güvenilir örnekler kullanın.

- Net çıktı formatı

- Doğruluk ve kaynak hassasiyeti vurgulanmalıdır.

3. Role Prompting (Rol Verme)

Yapay zekâdan alınan yanıtların kalitesi, yalnızca sorunun içeriğine değil, modelin hangi “rol” içinde cevap verdiğine de bağlıdır. Role Prompting (Rol Verme), modele belirli bir kimlik veya uzmanlık alanı tanımlayarak daha disiplinli, tutarlı ve amaca uygun yanıtlar elde etmeyi amaçlayan güçlü bir tekniktir.

Güçlü yönleri:

- Modele “uzman”, “akademik araştırmacı” veya “profesyonel editör” gibi roller vermek,yanıtların daha disiplinli ve kontrollü olmasını sağlar.

Zayıf yönleri:

- Rol tek başına doğru bilgi garantisi vermez; model hâlâ uydurma yapabilir.

Öneriler:

Rol tanımını detaylandırın:

Kaynağa dayalı yanıt ver.

Emin olmadığın durumlarda bunu açıkça belirt.

Varsayım yapma, doğrulanabilir bilgi kullan.Örnek prompt:

Bir biyoloji uzmanı olarak yanıt ver. Açıklamalarını bilimsel ve

doğrulanabilir bilgilere dayandır. Emin olmadığın noktaları belirt ve

varsayım yapma. Fotosentez sürecini açıkla.4. Multi-step Prompting (Çok Aşamalı İstek)

Yapay zekâdan alınan yanıtların kalitesini artırmanın en etkili yollarından biri, problemi tek seferde çözmesini beklemek yerine adım adım ilerlemesini sağlamaktır. İşte bu yaklaşım Multi-step Prompting (Çok Aşamalı İstek) olarak adlandırılır.

Bu teknik, özellikle karmaşık ve çok katmanlı görevlerde modelin daha doğru, tutarlı ve güvenilir sonuçlar üretmesine yardımcı olur.

Güçlü yönleri:

- Karmaşık görevleri parçalara ayırır.

- Mantık zinciri bozulmadan ilerlenmesini sağlar.

- Halüsinasyonu belirgin şekilde azaltır.

- Özellikle; sayısal problemler, veri analizi ve teknik raporlar için etkili bir yöntemdir.

Öneriler:

Prompt içindeki aşamaları netleştirin:

Problemi analiz et

Çözüm adımlarını oluştur

Her adımı doğrula

Sonucu kontrol et5. Rewriting/Optimization Prompting (Yeniden Yazma & Optimizasyon)

Bu teknik, modelin kendi ürettiği içeriği tekrar gözden geçirmesini, düzeltmesini ve iyileştirmesini sağlar. Yani amaç, ilk çıktıyı atmak değil, onu daha doğru, daha net ve daha güvenilir hale getirmektir.

Güçlü yönleri:

- Modelin ürettiği cevabı ikinci kez denetlemesini sağlar.

- Yanlış, eksik veya belirsiz ifadelerin fark edilmesine yardımcı olur.

Öneriler:

Aşağıdaki türde talimatlar ekleyin:

Metni yeniden yazarken yanlış veya doğrulanmamış bilgileri düzelt.

Eksik veya hatalı ifadeleri kaynağa dayalı olarak güncelle.

Varsayımları açıkça belirt veya kaldır.6. Hibrit Prompt Yaklaşımı

Buraya kadar, yapay zekâ modellerinde halüsinasyon (yanlış veya uydurma bilgi üretimi) etkisini azaltmak için kullanılabilecek farklı prompt tekniklerini inceledik. Her bir teknik tek başına önemli avantajlar sunsa da, en güçlü sonuçlar bu yöntemlerin birlikte kullanılmasıyla elde edilir.

Benim önerdiğim yaklaşım, bu teknikleri birbirini tamamlayacak şekilde bir araya getirmektir. Çünkü her biri farklı bir zayıflığı kapatır ve süreci daha kontrollü hale getirir.

- Role Prompting → Uzman rolü ver

- Few-shot Prompting → Doğru format ve bilgi tarzı

- Chain-of-Thought → Mantıklı ve tutarlı akış

- Multi-step Prompting → Aşamalı kontrol

- Optimization / Rewriting → Son denetim ve düzeltme

Bu kombinasyon özellikle:

- Sayısal problemler

- Mantık soruları

- Veri analizi

- Teknik ve akademik içerikler için son derece etkilidir.

Gerçek Senaryolarla Hibrit Prompt Yaklaşımı

(Role + Chain-of-Thought + Multi-step + Few-shot + Optimization)

Senaryo 1: Veri Analizi (İş Karar Destek)

Amaç: Satış verisine bakarak düşüş nedenlerini analiz etmek (halüsinasyon riski yüksek bir senaryo).

[ROLE PROMPTING]

Sen kıdemli bir veri analistisin.

Cevaplarını yalnızca verilen veriye ve doğrulanabilir çıkarımlara dayandır.

Veri dışı varsayım yapma, emin olmadığın noktaları açıkça belirt.

[MULTI-STEP PROMPTING]

Aşağıdaki görevi şu adımlarla ele al:

1. Veriyi analiz et

2. Olası nedenleri veriye dayalı olarak çıkar

3. Belirsiz noktaları belirt

4. Sonuçları özetle

[CHAIN-OF-THOUGHT PROMPTING]

Her adımda mantığını açıkça göster.

Eğer bir adım veriyle desteklenemiyorsa bunu belirt.

[FEW-SHOT PROMPTING]

Örnek:

Veri: Son 3 ayda web trafiği %20 düştü.

Analiz: Trafik düşüşü, pazarlama harcamalarının azaltılmasıyla ilişkilendirilebilir.

Not: Nedensellik için ek veri gerekir.

[GERÇEK GÖREV]

Veri:

- Ocak satış: 1200

- Şubat satış: 1100

- Mart satış: 850

Analiz et.

[OPTIMIZATION / SELF-CHECK]

Cevabını bitirdikten sonra:

- Varsayım içeren ifadeleri kontrol et

- Gerekirse düzelt

- Sonucu kısa ve net biçimde yeniden yazSenaryo 2: İş Kararı (Risk Analizi)

Amaç: Yeni bir kararın risklerini değerlendirmek.

[ROLE PROMPTING]

Sen bir iş stratejisi danışmanısın.

Sadece verilen bilgilere göre analiz yap.

[MULTI-STEP PROMPTING]

1.Durumu analiz et

2.Olası riskleri belirle

3.Her riski gerekçelendir

4.Belirsiz alanları belirt

[CHAIN-OF-THOUGHT PROMPTING]

Her riski açık mantıkla açıkla.

[FEW-SHOT PROMPTING]

Örnek:

Durum: Yeni pazara giriş

Risk: Talep belirsizliği

Not: Veri eksik

[GERÇEK GÖREV]

Durum:

Şirket, yeni bir ülkeye yatırım yapmayı planlıyor ancak pazar

araştırması henüz tamamlanmadı.

[OPTIMIZATION]

Abartılı çıkarımları kaldır

Riskleri net ve kısa yazSenaryo 3: Eğitim/Akademik İçerik

Amaç: Eğitim/Akademik içerik hazırlarken modelin “akademik gibi görünen uydurma” bilgi üretmesini önlemek

[ROLE PROMPTING]

Sen akademik bir içerik editörüsün.

Doğrulanmamış bilgi ekleme.

[MULTI-STEP PROMPTING]

1. Kavramı tanımla

2. Temel bileşenlerini açıkla

3. Bilinmeyen veya tartışmalı noktaları belirt

4. Kısa bir özet yaz

[CHAIN-OF-THOUGHT PROMPTING]

Açıklamaları mantıksal sırayla yap.

[GERÇEK GÖREV]

Transformer mimarisinin temel çalışma prensibini açıkla.

[OPTIMIZATION]

Metni kontrol et:

- Uydurma terim veya yanlış genelleme var mı?

- Gerekirse düzeltSenaryo 4: E-posta Analizi (Müşteri Şikayet Yönetimi)

Amaç: Müşteri şikayetlerini analiz edip ana problemi doğru tespit etmek.

[ROLE PROMPTING]

Sen deneyimli bir müşteri deneyimi uzmanısın.

Yalnızca verilen metne dayanarak analiz yap.

Varsayım yapma, emin olmadığın noktaları belirt.

[MULTI-STEP PROMPTING]

Aşağıdaki adımları takip et:

Müşteri mesajını analiz et

Ana problemi belirle

Alt problemleri çıkar

Belirsiz noktaları belirt

Kısa bir çözüm önerisi sun

[CHAIN-OF-THOUGHT PROMPTING]

Her adımda mantığını açıkla.

Metinde açıkça geçmeyen bilgileri varsayma.

[FEW-SHOT PROMPTING]

Örnek:

Mesaj: "Kargom geç geldi ve ürün hasarlıydı."

Analiz: Teslimat gecikmesi ve ürün hasarı problemi var.

Not: Hasarın kaynağı belirsiz.

[GERÇEK GÖREV]

Mesaj:

"3 gün önce sipariş verdim, hâlâ hazırlanıyor görünüyor.

Ayrıca müşteri hizmetlerine ulaşamadım."

[OPTIMIZATION]

Varsayım içeren kısımları kontrol et

Gerekirse düzelt

Sonucu kısa ve net özetleÖrneklerden de anlaşılacağı üzere, prompt mühendisliği, yapay zekâ modellerinden elde edilen çıktının doğruluğu, tutarlılığı ve güvenilirliğini doğrudan belirleyen kritik bir disiplindir. Doğru kısıtları tanımlamak, modele net bir rol vermek, örnek soru-cevaplar eklemek ve düşünce zincirlerini doğru şekilde kurgulamak; hem daha tutarlı ve kaliteli sonuçlar almamızı sağlar hem de halüsinasyon riskini ciddi ölçüde azaltır. Bu yaklaşım, modelin sahip olduğu yetenekleri daha görünür hâle getirmenin en etkili yollarından biridir. Elbette, model performansını artıran ve halüsinasyonu azaltmaya yardımcı olan RAG (Retrieval-Augmented Generation) veya Fine-Tuning gibi ileri teknikler de kritik durumlarda doğruluğu artırmak için kullanılabilir. Bu konulara da sonraki yazılarda değinmek üzere.

Faydalı olması dileğiyle.

Bir yanıt yazın